Squadron 42 Monthly Report: February 2020

Transmission Undefined Monthly ReportsContent

This is a cross-post of the report that was recently sent out via the monthly Squadron 42 newsletter. We’re publishing this a second time as a Comm-Link to make it easier for the community to reference back to. Attention Recruits,

What you are about to read is the latest information on the continuing development of Squadron 42 (SCI des: SQ42).

Operatives around the world collected the intel needed to provide you with this progress report. As a result, we now have key information on the methodology behind cinematics, approved unique UI designs, and how to make a perfect head of hair.

The information contained in this communication is extremely sensitive and it is of paramount importance that it does not fall into the wrong hands. Purge all records after reading.

UEE Naval High Command

AI

Character Combat kick off February’s report, who spent the month making progress on combat behaviors, specifically iterating on the assault and hold position tactics. They improved the Reservation Manager System usually employed to reserve object use in the world. This was achieved by adding the ability for NPCs to reserve volumes of space to correctly position themselves and retain the knowledge of where the AI wants them to go. They began adjusting the AI system to accommodate server meshing. The main requirement for this is to split the responsibility of the different systems by server so that the Networking Team can correctly test and identify problems as soon as possible. They’re also tweaking the navigation system to better support the object container streaming level design workflow. This involves constructing a pipeline where navigation data is embedded in each container to improve control over which portions of data are loaded. Also, time was dedicated to the routine code clean-up that’s crucial to keeping the ever-growing code base efficient and readable. This clean-up focused mostly on flight-related Subsumption tasks with heavily repeated (or ‘boilerplate’) code that could be abstracted away to reduce the likelihood of errors when implementing new tasks.

Ship AI completed the first iteration of the full 3D navigation system for NPC ships. The system is currently with QA for testing before it’s integrated into Alpha 3.9. This is an important step as it offers new opportunities to implement more diverse missions not limited to open-space environments. Thanks to dynamic collision avoidance, they were able to remove the current speed limits on all AI ships. Instead of a capped standard combat mode (SCM) speed, NPCs can now set their own according to the desired relative goal velocity.

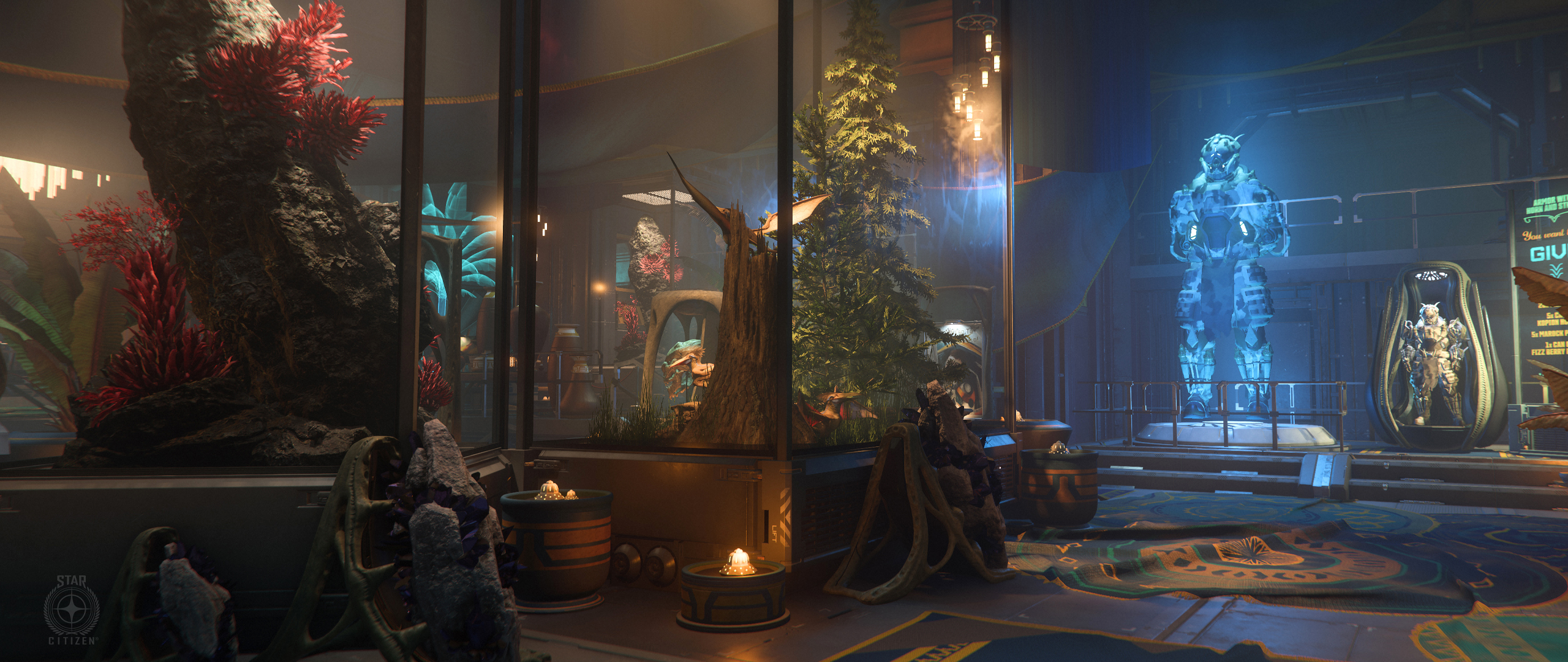

Social AI continued polishing vendor behavior, readying it for use in the bar setups and shops. Last month’s focus was preparing and delivering drinks and cocktails – a multi-disciplinary effort that will define the pipeline for all future social environments work in the PU. When finished, the team will be able to generate content and create templates for multiple layouts much quicker. Currently, the vendor can pick up and deliver anything that already exists in the world, such as a bottle of beer, and prepare many things that don’t, such as a cocktail. They’re also working on other social behaviors, such as fitness and janitor activities. Both leverage the in-development ‘path scripting’ functionality. The purpose of this is to use the environment to define the AI’s possible options, such as cleaning and patrolling, and can be used to simplify the scripting of story scenes. It works by allowing a designer to lay down paths in the environment, create branches for each vertex, and define which subsumption logic can be executed and which conditions should be met.

Art (Characters)

Character’s February focus was on hair, uniforms, and quality. They completed two new hairstyles, including that of Captain Noah White. They thoroughly tested the Maya tools for hair authoring and are extremely pleased with the results and how the tool’s holding up to full production. They currently working on blonde hair, investigating how it behaves with the current shader; the aim is to make it as realistic a shade as possible. They also continued making passes on character heads and have started work on the rest of the Bridge Officer Uniform assets. Next on the list are battledress uniforms, which are expected to take two months to complete in their entirety.

Cinematics

“‘Real-time, all the time’ isn’t just a mantra that veteran real-time engine users appreciate, it’s often the reason they fell in love with the workflows and engine in the first place. It enables artists and designers to quickly iterate without having to resort to offline build processes or tools not capable of giving real-time results, making creative decision-making instant and not reliant on delayed feedback loops. During tools production, we have to write this mantra on a battle banner and wave it every time new tech is built. With a technologically challenging and beyond cutting-edge game universe, the push to keep things in real-time can become complex. For example, in cinematics, it’s magnitudes easier to resort to a traditional offline rendering workflow. Offline, you can crank up the detail, lighting, shadows, motion blur, LODs, and depth of field to the max before rendering out an image sequence and cutting the final sequence together in video-editing software. However, the end-result is a video with fixed resolution and bitrate that then has to be added to the build using a video codec that can highlight that elements or full sequences aren’t real-time. To maintain authenticity and immersion in SQ42, the goal has always been to push for real-time cinematics during even the biggest set-piece sequences.”

- The Cinematics Team

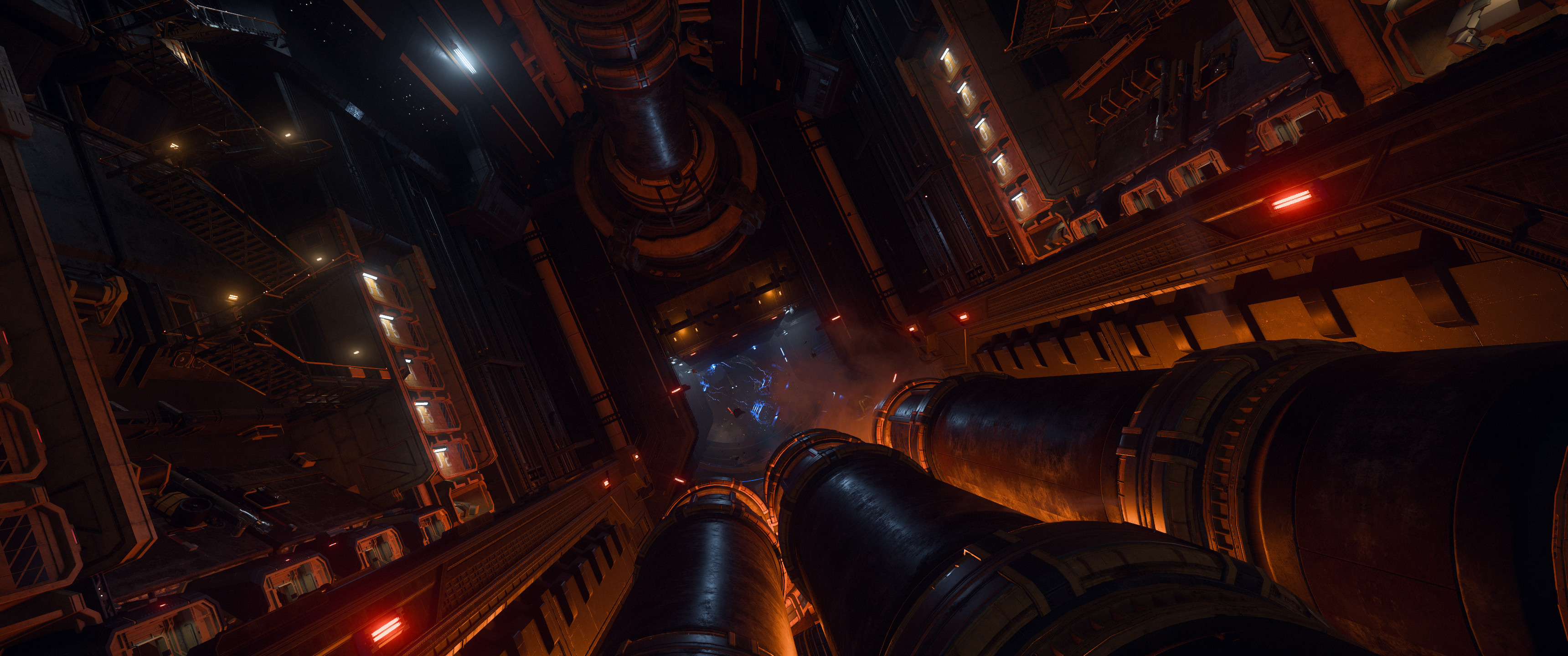

February saw Cinematics push one of the most challenging sequences through its second pass, locking down the timing before starting VFX and destruction simulation. The upgraded TrackView sequencer tool was completed, finally enabling the team to edit these long, epic sequences in real-time. They added several sub-sequence abilities and a camera priority logic based on the sequence sitting on top. These sequences behave like video clips, making it possible to edit complex setups in real-time, shifting each sub-sequence around on the master timeline. For example, the team can have individual capital ships and exterior fleets on separate sequences and combine them all in a master, with the ability to quickly assert where they want the camera cuts to happen. Another challenge is to get the streaming system working when cutting back and forth between several distant locations. Most game-streaming tech is built with the assumption shots aren’t constantly cutting back and forth between different locales, so getting this polished is the upcoming focus for the team’s workflow.

Engineering

In Frankfurt, Engineering worked on physics threading and performance, including investigating the full parallelization of integration parts in physics time step-code, multithreading the polygonize function for interior volumes, continuing concurrent/immediate queuing for physics, implementing local command queues, and adding an option to create queues on demand. They began finalizing and integrating the new signed distance field (SDF) system to accelerate collision checks on complex geometry and increase the precision of results. Unified fields can now be animated as any other part (they’re still special in some regards, but can be seen as a regular part from the outside) and distance fields on objects can be taken into account when sampling distances.

Optimization-wise, they disabled physics on skin attachments and made OC and SDF-size improvements and allocation optimizations for interior volumes. They enabled foliage to support 64-bit precision status updates and zones, made render proxy for ropes work with the zone system, continued work on death reaction animations, and provided support for actor/ragdoll body dragging.

Work was done to the zone system, while a culling update thread to parallelize updates of spatial culling structures was introduced. The team optimized streaming by skipping many unnecessary atomic operations on smart pointer copies and reduced the parallelization of occlusion culling. They also made improvements to the concurrent access check (support checking RW-lock semantics) and WAF improvements.

In support of the Gen12 renderer and Vulkan, they generalized texture views, refactored the texture creation process and remaining D3D texture view code, added MSAA support, removed old direct VB/IB memory access code, added ViewInfo for access to common view/camera related parameters, and looked into moving shader parsing into the resource container. The first improvement pass for hair AO was made, which is now coupled with color, and dye shift softness was introduced. Ocean shader improvements were made too by porting ocean rendering to deferred and further working on cube map reflections.

The raymarcher was simplified by removing the explicit evaluations of segments to significantly compact generated code and reduce register usage. Non-linear stepping for raymarching was also implemented to improve quality at a reduced number of samples. Planet terrain was iterated on to support the rendering of large ground-based objects on the height and shadow maps. A persona live mo-cap plugin for the editor was created too. Finally, animation code was amended to ensure ragdolls work with ground alignment and the CHR chunk loader was simplified to initialize physics (which is still ongoing).

Specifically for SQ42, the team completed their work on the interrupt, rejoin, and abandon functionality for story scenes. They’re currently fixing various edge cases and visual problems, such as animation glitches, and adding a new system to give the designers better control over when and how events are triggered. Engineering also supported the cinematic designers with their required TrackView requirements, making sure everything works in the intended manner.

Gameplay Story

February was a busy but productive month for Gameplay Story, who worked on a wide variety of scenes, including supporting Design with animations for the abandon mechanic. They also reviewed NPC conversations with Design and Narrative, adding extra dialogue to make them more natural. All med-bay scenes in chapter six were updated to add proper start and end idles wherever possible. This was an extensive overhaul, resulting in conversations that can be triggered with much greater control. This will ensure the scenes look good and play out with the desired pacing. A scene with two characters carrying a large box up a ramp was completed after considerable mo-cap stitching and is currently looking great. Finally for Gameplay Story, new actor records and loadouts were created so several scene setups can be finalized.

Graphics

The Graphics Team continued crucial work on the Gen12/Vulkan renderer, converting the tiled-lighting and dynamic geometry systems to the new rendering paradigm. They also made various improvements to the automated testing system necessary to ensuring stability for the designers and artists.

Level Design

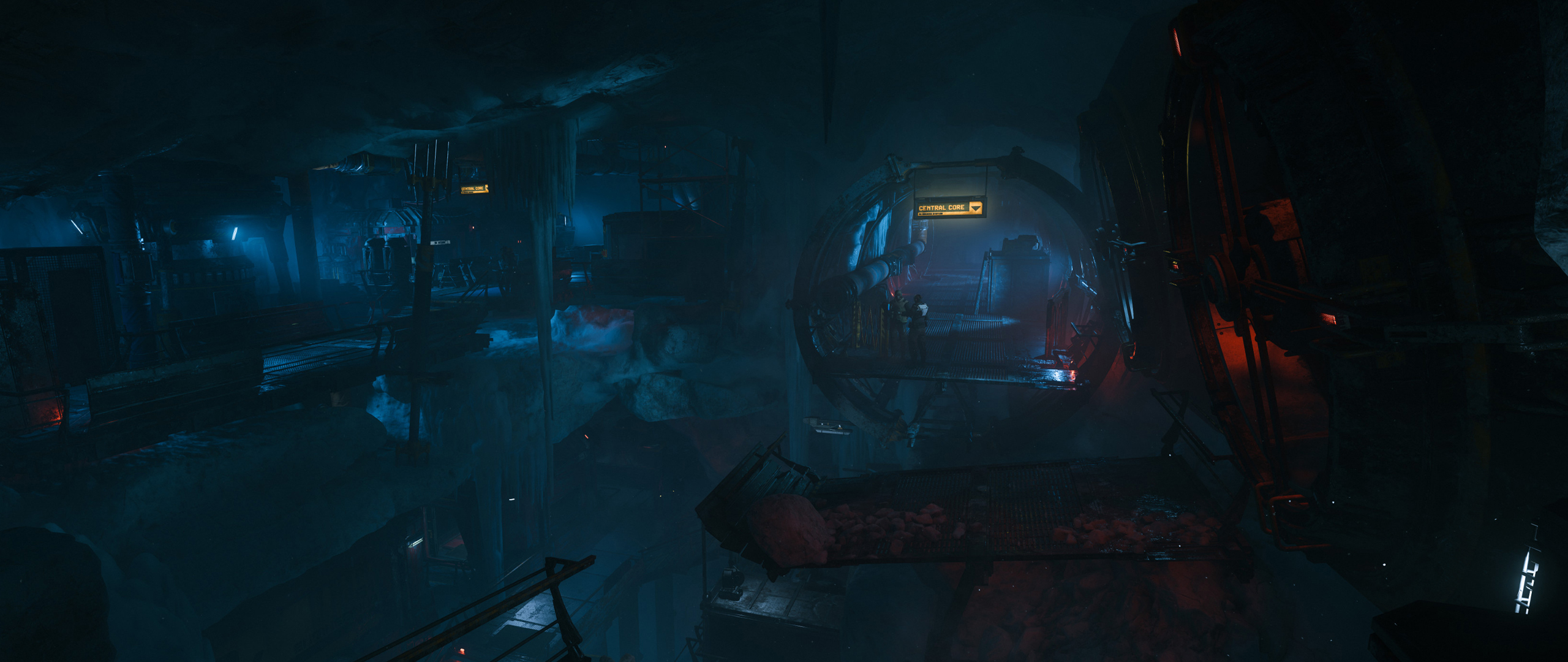

The Social Team, in collaboration with Animation and Engineering, continued work on narrative sequences and the abandon functionally. They’re currently focusing on early full-chapter playthroughs that introduce players to the life of a UEEN pilot. They continue to work closely with the FPS AI Feature Team to place and refine AI behaviors. One of the main aims is to have NPCs behave realistically, regardless of the environment they’re placed in. The game’s levels are designed to be architecturally believable spaces, so the AI needs to adapt to them in believable ways. The Dogfighting Team are working with Flight AI to refine scenarios that require custom engineering support. They’re also supporting the ongoing ambient ship-life work and take-off/landing updates.

Narrative

Some of the US-based Narrative Team visited the UK studios to review the latest level progress and oversee a female-character mo-cap session. They also reviewed the smaller NPC conversations with the Gameplay Story Team to ensure they’re as believable as possible.

QA

Combat and Ship AI test cases were implemented, which the team will start testing regularly. They’re still tasked with creating recorded client scene captures of individual chapters and are currently investigating issues hindering the cinematics workflow.

Tech Animation

Tech Animation improved visuals for character loadouts alongside Character Art and Cinematic Design. They added engine loadouts to Maya to enable the animators to complete their polish pass on the same loadout the characters will wear in-game. The animation workflow was improved by fixing several bugs and adding tools to the pipeline to speed up the bake process for bigger scenes.

Several new weapons reached Tech Animation, while the Social AI Team was supported with new usables for sitting, standing, exercise spots, and the bartender. They also worked with Props to solve problems with their rigger tool and fixed bugs for Design, Animation, and Art.

Tech Art

Last month, Tech Animation implemented a new rig-logic editing plugin command for Maya. For performance and efficiency, the backend was implemented in C++. The Qt-based frontend/UI layer is currently implemented using python. While the Vanduul face rigs already use this new runtime rig logic, all 120+ human face-rigs will soon be ported over to the new system.

User Interface (UI)

February saw UI helping the Actor Team finalize visuals for the Inner Thought radial menu. After a lot of concepting and UI design, the new SQ42-specific visor and visual target were approved. Prototyping is ongoing before code work begins next month.

VFX

The UK’s VFX Team closed out the month tweaking several existing background effects and taking advantage of recent improvements to the particle system’s parent/child hierarchy. Investigation into further methods of triggering particle effects through gas tech was started too.

In Frankfurt, the team worked with the programmers to lockdown the final list of features required for SQ42. This included fixing long-standing bugs on the GPU system, including inconsistencies with parent/child spawning, to give a much deeper hierarchy and more complex effects. This was tested with firework VFX that pushed the system to its limits and helped uncover previously unknown bugs.

WE’LL SEE YOU NEXT MONTH…

What you are about to read is the latest information on the continuing development of Squadron 42 (SCI des: SQ42).

Operatives around the world collected the intel needed to provide you with this progress report. As a result, we now have key information on the methodology behind cinematics, approved unique UI designs, and how to make a perfect head of hair.

The information contained in this communication is extremely sensitive and it is of paramount importance that it does not fall into the wrong hands. Purge all records after reading.

UEE Naval High Command

AI

Character Combat kick off February’s report, who spent the month making progress on combat behaviors, specifically iterating on the assault and hold position tactics. They improved the Reservation Manager System usually employed to reserve object use in the world. This was achieved by adding the ability for NPCs to reserve volumes of space to correctly position themselves and retain the knowledge of where the AI wants them to go. They began adjusting the AI system to accommodate server meshing. The main requirement for this is to split the responsibility of the different systems by server so that the Networking Team can correctly test and identify problems as soon as possible. They’re also tweaking the navigation system to better support the object container streaming level design workflow. This involves constructing a pipeline where navigation data is embedded in each container to improve control over which portions of data are loaded. Also, time was dedicated to the routine code clean-up that’s crucial to keeping the ever-growing code base efficient and readable. This clean-up focused mostly on flight-related Subsumption tasks with heavily repeated (or ‘boilerplate’) code that could be abstracted away to reduce the likelihood of errors when implementing new tasks.

Ship AI completed the first iteration of the full 3D navigation system for NPC ships. The system is currently with QA for testing before it’s integrated into Alpha 3.9. This is an important step as it offers new opportunities to implement more diverse missions not limited to open-space environments. Thanks to dynamic collision avoidance, they were able to remove the current speed limits on all AI ships. Instead of a capped standard combat mode (SCM) speed, NPCs can now set their own according to the desired relative goal velocity.

Social AI continued polishing vendor behavior, readying it for use in the bar setups and shops. Last month’s focus was preparing and delivering drinks and cocktails – a multi-disciplinary effort that will define the pipeline for all future social environments work in the PU. When finished, the team will be able to generate content and create templates for multiple layouts much quicker. Currently, the vendor can pick up and deliver anything that already exists in the world, such as a bottle of beer, and prepare many things that don’t, such as a cocktail. They’re also working on other social behaviors, such as fitness and janitor activities. Both leverage the in-development ‘path scripting’ functionality. The purpose of this is to use the environment to define the AI’s possible options, such as cleaning and patrolling, and can be used to simplify the scripting of story scenes. It works by allowing a designer to lay down paths in the environment, create branches for each vertex, and define which subsumption logic can be executed and which conditions should be met.

Art (Characters)

Character’s February focus was on hair, uniforms, and quality. They completed two new hairstyles, including that of Captain Noah White. They thoroughly tested the Maya tools for hair authoring and are extremely pleased with the results and how the tool’s holding up to full production. They currently working on blonde hair, investigating how it behaves with the current shader; the aim is to make it as realistic a shade as possible. They also continued making passes on character heads and have started work on the rest of the Bridge Officer Uniform assets. Next on the list are battledress uniforms, which are expected to take two months to complete in their entirety.

Cinematics

“‘Real-time, all the time’ isn’t just a mantra that veteran real-time engine users appreciate, it’s often the reason they fell in love with the workflows and engine in the first place. It enables artists and designers to quickly iterate without having to resort to offline build processes or tools not capable of giving real-time results, making creative decision-making instant and not reliant on delayed feedback loops. During tools production, we have to write this mantra on a battle banner and wave it every time new tech is built. With a technologically challenging and beyond cutting-edge game universe, the push to keep things in real-time can become complex. For example, in cinematics, it’s magnitudes easier to resort to a traditional offline rendering workflow. Offline, you can crank up the detail, lighting, shadows, motion blur, LODs, and depth of field to the max before rendering out an image sequence and cutting the final sequence together in video-editing software. However, the end-result is a video with fixed resolution and bitrate that then has to be added to the build using a video codec that can highlight that elements or full sequences aren’t real-time. To maintain authenticity and immersion in SQ42, the goal has always been to push for real-time cinematics during even the biggest set-piece sequences.”

- The Cinematics Team

February saw Cinematics push one of the most challenging sequences through its second pass, locking down the timing before starting VFX and destruction simulation. The upgraded TrackView sequencer tool was completed, finally enabling the team to edit these long, epic sequences in real-time. They added several sub-sequence abilities and a camera priority logic based on the sequence sitting on top. These sequences behave like video clips, making it possible to edit complex setups in real-time, shifting each sub-sequence around on the master timeline. For example, the team can have individual capital ships and exterior fleets on separate sequences and combine them all in a master, with the ability to quickly assert where they want the camera cuts to happen. Another challenge is to get the streaming system working when cutting back and forth between several distant locations. Most game-streaming tech is built with the assumption shots aren’t constantly cutting back and forth between different locales, so getting this polished is the upcoming focus for the team’s workflow.

Engineering

In Frankfurt, Engineering worked on physics threading and performance, including investigating the full parallelization of integration parts in physics time step-code, multithreading the polygonize function for interior volumes, continuing concurrent/immediate queuing for physics, implementing local command queues, and adding an option to create queues on demand. They began finalizing and integrating the new signed distance field (SDF) system to accelerate collision checks on complex geometry and increase the precision of results. Unified fields can now be animated as any other part (they’re still special in some regards, but can be seen as a regular part from the outside) and distance fields on objects can be taken into account when sampling distances.

Optimization-wise, they disabled physics on skin attachments and made OC and SDF-size improvements and allocation optimizations for interior volumes. They enabled foliage to support 64-bit precision status updates and zones, made render proxy for ropes work with the zone system, continued work on death reaction animations, and provided support for actor/ragdoll body dragging.

Work was done to the zone system, while a culling update thread to parallelize updates of spatial culling structures was introduced. The team optimized streaming by skipping many unnecessary atomic operations on smart pointer copies and reduced the parallelization of occlusion culling. They also made improvements to the concurrent access check (support checking RW-lock semantics) and WAF improvements.

In support of the Gen12 renderer and Vulkan, they generalized texture views, refactored the texture creation process and remaining D3D texture view code, added MSAA support, removed old direct VB/IB memory access code, added ViewInfo for access to common view/camera related parameters, and looked into moving shader parsing into the resource container. The first improvement pass for hair AO was made, which is now coupled with color, and dye shift softness was introduced. Ocean shader improvements were made too by porting ocean rendering to deferred and further working on cube map reflections.

The raymarcher was simplified by removing the explicit evaluations of segments to significantly compact generated code and reduce register usage. Non-linear stepping for raymarching was also implemented to improve quality at a reduced number of samples. Planet terrain was iterated on to support the rendering of large ground-based objects on the height and shadow maps. A persona live mo-cap plugin for the editor was created too. Finally, animation code was amended to ensure ragdolls work with ground alignment and the CHR chunk loader was simplified to initialize physics (which is still ongoing).

Specifically for SQ42, the team completed their work on the interrupt, rejoin, and abandon functionality for story scenes. They’re currently fixing various edge cases and visual problems, such as animation glitches, and adding a new system to give the designers better control over when and how events are triggered. Engineering also supported the cinematic designers with their required TrackView requirements, making sure everything works in the intended manner.

Gameplay Story

February was a busy but productive month for Gameplay Story, who worked on a wide variety of scenes, including supporting Design with animations for the abandon mechanic. They also reviewed NPC conversations with Design and Narrative, adding extra dialogue to make them more natural. All med-bay scenes in chapter six were updated to add proper start and end idles wherever possible. This was an extensive overhaul, resulting in conversations that can be triggered with much greater control. This will ensure the scenes look good and play out with the desired pacing. A scene with two characters carrying a large box up a ramp was completed after considerable mo-cap stitching and is currently looking great. Finally for Gameplay Story, new actor records and loadouts were created so several scene setups can be finalized.

Graphics

The Graphics Team continued crucial work on the Gen12/Vulkan renderer, converting the tiled-lighting and dynamic geometry systems to the new rendering paradigm. They also made various improvements to the automated testing system necessary to ensuring stability for the designers and artists.

Level Design

The Social Team, in collaboration with Animation and Engineering, continued work on narrative sequences and the abandon functionally. They’re currently focusing on early full-chapter playthroughs that introduce players to the life of a UEEN pilot. They continue to work closely with the FPS AI Feature Team to place and refine AI behaviors. One of the main aims is to have NPCs behave realistically, regardless of the environment they’re placed in. The game’s levels are designed to be architecturally believable spaces, so the AI needs to adapt to them in believable ways. The Dogfighting Team are working with Flight AI to refine scenarios that require custom engineering support. They’re also supporting the ongoing ambient ship-life work and take-off/landing updates.

Narrative

Some of the US-based Narrative Team visited the UK studios to review the latest level progress and oversee a female-character mo-cap session. They also reviewed the smaller NPC conversations with the Gameplay Story Team to ensure they’re as believable as possible.

QA

Combat and Ship AI test cases were implemented, which the team will start testing regularly. They’re still tasked with creating recorded client scene captures of individual chapters and are currently investigating issues hindering the cinematics workflow.

Tech Animation

Tech Animation improved visuals for character loadouts alongside Character Art and Cinematic Design. They added engine loadouts to Maya to enable the animators to complete their polish pass on the same loadout the characters will wear in-game. The animation workflow was improved by fixing several bugs and adding tools to the pipeline to speed up the bake process for bigger scenes.

Several new weapons reached Tech Animation, while the Social AI Team was supported with new usables for sitting, standing, exercise spots, and the bartender. They also worked with Props to solve problems with their rigger tool and fixed bugs for Design, Animation, and Art.

Tech Art

Last month, Tech Animation implemented a new rig-logic editing plugin command for Maya. For performance and efficiency, the backend was implemented in C++. The Qt-based frontend/UI layer is currently implemented using python. While the Vanduul face rigs already use this new runtime rig logic, all 120+ human face-rigs will soon be ported over to the new system.

User Interface (UI)

February saw UI helping the Actor Team finalize visuals for the Inner Thought radial menu. After a lot of concepting and UI design, the new SQ42-specific visor and visual target were approved. Prototyping is ongoing before code work begins next month.

VFX

The UK’s VFX Team closed out the month tweaking several existing background effects and taking advantage of recent improvements to the particle system’s parent/child hierarchy. Investigation into further methods of triggering particle effects through gas tech was started too.

In Frankfurt, the team worked with the programmers to lockdown the final list of features required for SQ42. This included fixing long-standing bugs on the GPU system, including inconsistencies with parent/child spawning, to give a much deeper hierarchy and more complex effects. This was tested with firework VFX that pushed the system to its limits and helped uncover previously unknown bugs.

WE’LL SEE YOU NEXT MONTH…

Dies ist ein Querverweis auf den Bericht, der kürzlich über den monatlichen Squadron 42-Newsletter verschickt wurde. Wir veröffentlichen ihn ein zweites Mal als Comm-Link, um es der Gemeinschaft zu erleichtern, auf ihn zurückzugreifen.

Achtung Rekruten,

Was Sie gleich lesen werden, sind die neuesten Informationen über die weitere Entwicklung der Staffel 42 (SCI des: SQ42).

Operateure auf der ganzen Welt haben die notwendigen Informationen gesammelt, um Ihnen diesen Fortschrittsbericht zur Verfügung zu stellen. Als Ergebnis haben wir nun Schlüsselinformationen über die Methodik hinter der Kinematik, über genehmigte einzigartige UI-Designs und darüber, wie man einen perfekten Haarkopf herstellt.

Die in dieser Mitteilung enthaltenen Informationen sind äußerst sensibel, und es ist von größter Wichtigkeit, dass sie nicht in die falschen Hände gelangen. Löschen Sie alle Aufzeichnungen nach dem Lesen.

Oberkommando der UEE-Marine

KI

Character Combat ist der Auftakt zum Februar-Bericht, der den Monat damit verbrachte, Fortschritte im Kampfverhalten zu erzielen, insbesondere durch Wiederholung der Angriffs- und Haltepositionstaktik. Sie verbesserten das Reservations-Manager-System, das normalerweise für den Einsatz von Objekten in der Welt eingesetzt wird. Dies wurde dadurch erreicht, dass die NPCs nun in der Lage sind, Raumvolumina zu reservieren, um sich korrekt zu positionieren und das Wissen darüber zu behalten, wohin die KI sie führen soll. Sie begannen damit, das KI-System so anzupassen, dass es die Vermaschung von Servern ermöglicht. Die wichtigste Voraussetzung dafür ist die Aufteilung der Verantwortung der verschiedenen Systeme nach Servern, damit das Networking-Team Probleme so schnell wie möglich korrekt testen und identifizieren kann. Außerdem passen sie das Navigationssystem an, um den Workflow für das Design der Streaming-Ebene von Objektcontainern besser zu unterstützen. Dazu gehört der Aufbau einer Pipeline, bei der Navigationsdaten in jeden Container eingebettet werden, um die Kontrolle darüber zu verbessern, welche Datenteile geladen werden. Außerdem wurde Zeit für die routinemäßige Code-Bereinigung aufgewendet, die entscheidend dafür ist, die ständig wachsende Code-Basis effizient und lesbar zu halten. Diese Bereinigung konzentrierte sich vor allem auf flugbezogene Subsumtionsaufgaben mit stark wiederholtem (oder "Boilerplate"-)Code, der weg abstrahiert werden konnte, um die Wahrscheinlichkeit von Fehlern bei der Implementierung neuer Aufgaben zu verringern.

Die Schiffs-KI schloss die erste Iteration des vollständigen 3D-Navigationssystems für NPC-Schiffe ab. Das System wird derzeit von der QA getestet, bevor es in Alpha 3.9 integriert wird. Dies ist ein wichtiger Schritt, da es neue Möglichkeiten zur Umsetzung vielfältiger Missionen bietet, die nicht auf Freifeldumgebungen beschränkt sind. Dank der dynamischen Kollisionsvermeidung konnten die derzeitigen Geschwindigkeitsbegrenzungen auf allen KI-Schiffen aufgehoben werden. Statt einer begrenzten Standardkampfmodus-Geschwindigkeit (SCM) können die NPCs nun ihre eigene Geschwindigkeit entsprechend der gewünschten relativen Zielgeschwindigkeit einstellen.

Die soziale KI hat das Verhalten der Anbieter weiter poliert und für den Einsatz in den Barbetrieben und Geschäften vorbereitet. Im letzten Monat lag der Schwerpunkt auf der Vorbereitung und Lieferung von Getränken und Cocktails - eine multidisziplinäre Anstrengung, die die Pipeline für alle zukünftigen Arbeiten im sozialen Umfeld der PU definieren wird. Nach Abschluss der Arbeit wird das Team in der Lage sein, Inhalte zu generieren und Vorlagen für verschiedene Layouts viel schneller zu erstellen. Zurzeit kann der Anbieter alles abholen und liefern, was es bereits auf der Welt gibt, z.B. eine Flasche Bier, und viele Dinge vorbereiten, die es nicht gibt, z.B. einen Cocktail. Sie arbeiten auch an anderen sozialen Verhaltensweisen, wie z.B. Fitness und Hausmeistertätigkeiten. Beide nutzen die in der Entwicklung befindliche "Pfad-Scripting"-Funktionalität. Sie dienen dazu, die Umgebung zu nutzen, um die möglichen Optionen der KI zu definieren, wie z.B. Reinigung und Patrouillenfahrten, und können dazu verwendet werden, das Skripting von Geschichtenszenen zu vereinfachen. Es funktioniert, indem es einem Designer erlaubt, Pfade in der Umgebung festzulegen, Verzweigungen für jeden Vertex zu erstellen und zu definieren, welche Subsumtionslogik ausgeführt werden kann und welche Bedingungen erfüllt sein sollten.

Kunst (Zeichen)

Der Schwerpunkt von Character lag im Februar auf Haar, Uniformen und Qualität. Sie stellten zwei neue Frisuren fertig, darunter die von Captain Noah White. Sie testeten die Maya-Werkzeuge für das Haar-Authoring ausgiebig und sind mit den Ergebnissen und der Haltbarkeit des Werkzeugs bis zur vollen Produktion äußerst zufrieden. Derzeit arbeiten sie an blondem Haar und untersuchen, wie es sich mit dem aktuellen Shader verhält; Ziel ist es, es so realistisch wie möglich zu machen. Sie haben auch weiterhin auf die Charakterköpfe verzichtet und haben mit der Arbeit an den restlichen Vorzügen der Brückenoffizier-Uniform begonnen. Als nächstes stehen die Kampfanzüge auf der Liste, deren vollständige Fertigstellung voraussichtlich zwei Monate dauern wird.

Filmkunst

"'Echtzeit, die ganze Zeit' ist nicht nur ein Mantra, das erfahrene Benutzer von Echtzeit-Engines schätzen, sondern oft auch der Grund, warum sie sich überhaupt in die Workflows und die Engine verliebt haben. Sie ermöglicht es Künstlern und Designern, schnell zu iterieren, ohne auf Offline-Bauprozesse oder Tools zurückgreifen zu müssen, die keine Echtzeitergebnisse liefern können, und macht kreative Entscheidungen sofort und ohne verzögerte Feedback-Schleifen möglich. Während der Produktion von Werkzeugen müssen wir dieses Mantra auf ein Kampfbanner schreiben und es jedes Mal schwenken, wenn neue Technik gebaut wird. In einem technologisch herausfordernden und über die Grenzen des modernen Spieluniversums hinausgehenden Universums kann der Druck, die Dinge in Echtzeit zu halten, komplex werden. In der Filmkunst ist es beispielsweise einfacher, auf einen traditionellen Offline-Rendering-Workflow zurückzugreifen. Offline können Sie die Details, Beleuchtung, Schatten, Bewegungsunschärfe, LODs und Tiefenschärfe bis zum Maximum steigern, bevor Sie eine Bildsequenz rendern und die endgültige Sequenz in einer Videobearbeitungssoftware zusammenschneiden. Das Endergebnis ist jedoch ein Video mit fester Auflösung und Bitrate, das dann mit Hilfe eines Videocodecs, der hervorheben kann, dass Elemente oder vollständige Sequenzen nicht in Echtzeit vorliegen, in das Build eingefügt werden muss. Um die Authentizität und das Eintauchen in SQ42 zu gewährleisten, war es schon immer das Ziel, selbst bei den größten Sequenzen des Filmsatzes auf Echtzeit-Kinofilme zu drängen.

- Das Filmteam

Im Februar hat Cinematics eine der anspruchsvollsten Sequenzen durch den zweiten Durchgang geschoben und das Timing vor dem Start der VFX- und Zerstörungssimulation festgelegt. Das aktualisierte TrackView-Sequenzer-Tool wurde fertiggestellt, so dass das Team diese langen, epischen Sequenzen nun endlich in Echtzeit bearbeiten kann. Es fügte mehrere Untersequenz-Fähigkeiten und eine auf der Sequenz basierende Kameraprioritätslogik hinzu. Diese Sequenzen verhalten sich wie Videoclips, so dass es möglich ist, komplexe Setups in Echtzeit zu bearbeiten, wobei jede Teilsequenz auf der Master-Zeitachse verschoben wird. So kann das Team beispielsweise einzelne Großkampfschiffe und Außenflotten auf separaten Sequenzen haben und sie alle in einem Master kombinieren, mit der Fähigkeit, schnell zu behaupten, wo die Kameraschnitte stattfinden sollen. Eine weitere Herausforderung besteht darin, das Streaming-System zum Einsatz zu bringen, wenn zwischen mehreren entfernten Orten hin- und hergeschnitten wird. Bei den meisten Streaming-Technologien wird davon ausgegangen, dass die Aufnahmen nicht ständig zwischen verschiedenen Orten hin- und hergeschnitten werden. Daher wird der Schwerpunkt des Arbeitsablaufs des Teams in Zukunft darauf liegen, dies aufzupolieren.

Technik

In Frankfurt arbeitete die Technik an Physics Threading und Performance, einschließlich der Untersuchung der vollständigen Parallelisierung von Integrationsteilen im Physics Time Step Code, Multithreading der Polygonize-Funktion für Innenvolumen, Fortsetzung des Concurrent/Intermediate Queuing für die Physik, Implementierung lokaler Befehlswarteschlangen und Hinzufügen einer Option zur Erstellung von Warteschlangen bei Bedarf. Sie begannen mit der Fertigstellung und Integration des neuen SDF-Systems (Signed Distance Field), um die Kollisionsprüfung komplexer Geometrien zu beschleunigen und die Präzision der Ergebnisse zu erhöhen. Vereinheitlichte Felder können nun wie jeder andere Teil animiert werden (sie sind in mancher Hinsicht immer noch speziell, können aber von außen als regulärer Teil betrachtet werden) und Abstandsfelder auf Objekten können bei der Abtastung von Abständen berücksichtigt werden.

In Bezug auf die Optimierung haben sie die Physik auf Hautanhängen deaktiviert und Verbesserungen der OC- und SDF-Größe sowie Zuordnungsoptimierungen für Innenvolumen vorgenommen. Sie ermöglichten die Unterstützung von Statusaktualisierungen und Zonen mit 64-Bit-Präzision im Blattwerk, ließen Proxy-Rendering für Seile mit dem Zonensystem arbeiten, setzten die Arbeit an Animationen der Todesreaktion fort und unterstützten das Ziehen von Schauspielern/Ragdoll-Körpern.

Es wurde an dem Zonensystem gearbeitet, während ein Aktualisierungs-Thread für die Keulung eingeführt wurde, um Aktualisierungen der räumlichen Keulungsstrukturen zu parallelisieren. Das Team optimierte das Streaming, indem es viele unnötige atomare Operationen auf Smart-Pointer-Kopien übersprang und die Parallelisierung des Occlusion Culling reduzierte. Sie nahmen auch Verbesserungen bei der Prüfung des gleichzeitigen Zugriffs (Unterstützung der Prüfung der RW-Lock-Semantik) und Verbesserungen der WAF vor.

Zur Unterstützung des Gen12-Renderers und von Vulkan wurden Texturansichten verallgemeinert, der Texturerzeugungsprozess und der verbleibende D3D-Texturansichtscode überarbeitet, MSAA-Unterstützung hinzugefügt, der alte direkte VB/IB-Speicherzugriffscode entfernt, ViewInfo für den Zugriff auf gängige ansichts- und kamerabezogene Parameter hinzugefügt und das Verschieben des Shader-Parsing in den Ressourcencontainer untersucht. Der erste Verbesserungsdurchgang für Haar-AO wurde durchgeführt, der nun mit Farbe gekoppelt ist, und es wurde eine Weichheit der Farbstoffverschiebung eingeführt. Verbesserungen bei den Ozean-Shadern wurden ebenfalls vorgenommen, indem das Ozean-Rendering auf verzögerte und weitere Arbeiten an Würfelkartenreflexionen übertragen wurden.

Der Raymarcher wurde vereinfacht, indem die expliziten Auswertungen von Segmenten entfernt wurden, um den generierten Code deutlich zu verdichten und die Verwendung von Registern zu reduzieren. Außerdem wurde ein nichtlinearer Schritt für das Raymarchen implementiert, um die Qualität bei einer reduzierten Anzahl von Proben zu verbessern. Das Planetengelände wurde iterativ bearbeitet, um die Darstellung großer bodengebundener Objekte auf den Höhen- und Schattenkarten zu unterstützen. Es wurde auch ein Live-Mo-Cap-Plugin für den Editor erstellt. Schließlich wurde der Animationscode geändert, um sicherzustellen, dass die Ragdolls mit der Bodenausrichtung arbeiten, und der CHR-Chunk-Lader wurde vereinfacht, um die Physik zu initialisieren (was noch nicht abgeschlossen ist).

Speziell für SQ42 schloss das Team seine Arbeit an der Unterbrechung, dem Wiedereintritt und dem Verzicht auf die Funktionalität für Story-Szenen ab. Sie beheben derzeit verschiedene Randfälle und visuelle Probleme, wie z.B. Animationsstörungen, und fügen ein neues System hinzu, um den Designern eine bessere Kontrolle darüber zu geben, wann und wie Ereignisse ausgelöst werden. Die Technik unterstützte die Filmdesigner auch bei den erforderlichen TrackView-Anforderungen, um sicherzustellen, dass alles in der vorgesehenen Weise funktioniert.

Spielgeschichte

Der Februar war ein arbeitsreicher, aber produktiver Monat für Gameplay Story, der an einer Vielzahl von Szenen arbeitete, darunter auch die Unterstützung des Designs mit Animationen für den Abandon-Mechaniker. Sie überprüften auch die Gespräche der NPCs mit Design und Narrative und fügten zusätzliche Dialoge hinzu, um sie natürlicher zu gestalten. Alle Med-Bay-Szenen in Kapitel sechs wurden aktualisiert, um, wo immer möglich, korrekte Start- und End-Idle-Szenen hinzuzufügen. Dies war eine umfassende Überarbeitung, die zu Gesprächen führte, die mit viel mehr Kontrolle ausgelöst werden können. Dadurch wird sichergestellt, dass die Szenen gut aussehen und mit dem gewünschten Tempo ablaufen. Eine Szene mit zwei Figuren, die eine große Kiste eine Rampe hinauftragen, wurde nach einer beträchtlichen Mo-Cap-Naht fertiggestellt und sieht derzeit großartig aus. Schließlich wurden für die Gameplay-Story neue Schauspieleraufnahmen und Ladevorgänge erstellt, so dass mehrere Szenen-Setups fertig gestellt werden können.

Grafiken

Das Grafikteam setzte die entscheidende Arbeit am Gen12/Vulkan-Renderer fort und konvertierte die Systeme für Kachellicht und dynamische Geometrie in das neue Rendering-Paradigma. Sie machten auch verschiedene Verbesserungen am automatisierten Testsystem notwendig, um die Stabilität für die Designer und Künstler zu gewährleisten.

Level-Design

Das Sozialteam setzte in Zusammenarbeit mit Animation und Technik die Arbeit an den Erzählsequenzen und dem Verzicht auf die Funktion fort. Derzeit konzentrieren sie sich auf frühe, kapitelweise Durchspiele, die die Spieler in das Leben eines UEEN-Piloten einführen. Sie arbeiten weiterhin eng mit dem FPS AI Feature Team zusammen, um das Verhalten der KI zu platzieren und zu verfeinern. Eines der Hauptziele ist es, dass sich die NPCs realistisch verhalten, unabhängig von der Umgebung, in der sie sich befinden. Die Ebenen des Spiels sind so gestaltet, dass sie architektonisch glaubwürdige Räume sind, daher muss sich die KI auf glaubwürdige Weise an sie anpassen. Das Dogfighting-Team arbeitet mit der Flug-KI zusammen, um Szenarien zu verfeinern, die eine individuelle technische Unterstützung erfordern. Sie unterstützen auch die laufenden Arbeiten an der Umgebung und die Aktualisierungen der Schiffslebensdauer und der Start-/Landung.

Erzählung

Einige Mitglieder des in den USA ansässigen Erzählteams besuchten die britischen Studios, um die neuesten Fortschritte zu überprüfen und eine Sitzung mit Frauenfiguren zu beaufsichtigen. Sie überprüften auch die kleineren NPC-Gespräche mit dem Gameplay Story Team, um sicherzustellen, dass sie so glaubwürdig wie möglich sind.

QA

Es wurden Kampf- und Schiffs-KI-Testfälle implementiert, die das Team nun regelmäßig testen wird. Sie sind immer noch mit der Erstellung von aufgezeichneten Kundenszenenaufnahmen einzelner Kapitel beauftragt und untersuchen derzeit Probleme, die den filmischen Workflow behindern.

Technische Animation

Die Tech-Animation verbesserte das visuelle Erscheinungsbild für das Laden von Charakteren neben Character Art und Cinematic Design. Sie fügten den Maya-Engine-Auslastungen hinzu, damit die Animatoren ihren letzten Schliff mit derselben Auslastung erhalten, die die Charaktere im Spiel tragen werden. Der Animations-Workflow wurde durch die Behebung verschiedener Fehler und das Hinzufügen von Werkzeugen zur Pipeline verbessert, um den Backprozess für größere Szenen zu beschleunigen.

Mehrere neue Waffen erreichten die Tech Animation, während das soziale KI-Team mit neuen Gebrauchsgegenständen für das Sitzen, Stehen, Übungsplätze und den Barkeeper unterstützt wurde. Sie arbeiteten auch mit Props zusammen, um Probleme mit ihrem Rigger-Tool zu lösen und Fehler für Design, Animation und Kunst zu beheben.

Technische Kunst

Letzten Monat implementierte Tech Animation einen neuen Rig-Logic-Editing-Plugin-Befehl für Maya. Aus Gründen der Leistung und Effizienz wurde das Backend in C++ implementiert. Die Qt-basierte Frontend/UI-Schicht wird derzeit mit Python implementiert. Während die Vanduul-Face-Rigs bereits diese neue Runtime-Rig-Logik verwenden, werden bald alle über 120 Human Face-Rigs auf das neue System portiert werden.

Benutzerschnittstelle (UI)

Im Februar half die Benutzeroberfläche dem Schauspieler-Team bei der Fertigstellung der Visuals für das Radialmenü "Inner Thought". Nach einer Menge an Konzepten und UI-Design wurden das neue SQ42-spezifische Visier und das visuelle Ziel genehmigt. Die Prototypentwicklung ist im Gange, bevor im nächsten Monat die Code-Arbeiten beginnen.

VFX

Das britische VFX-Team schloss den Monat ab, indem es mehrere bestehende Hintergrundeffekte korrigierte und die jüngsten Verbesserungen der Eltern-Kind-Hierarchie des Partikelsystems nutzte. Die Untersuchung weiterer Methoden zur Auslösung von Partikeleffekten durch Gastechnik wurde ebenfalls begonnen.

In Frankfurt arbeitete das Team zusammen mit den Programmierern an der endgültigen Liste der für SQ42 erforderlichen Funktionen. Dazu gehörte die Behebung langjähriger Fehler auf dem GPU-System, einschließlich Inkonsistenzen mit der Eltern/Kind-Laichfähigkeit, um eine viel tiefere Hierarchie und komplexere Effekte zu erreichen. Dies wurde mit dem Feuerwerk VFX getestet, das das System an seine Grenzen brachte und half, bisher unbekannte Fehler aufzudecken.

WIR SEHEN UNS NÄCHSTEN MONAT...

Achtung Rekruten,

Was Sie gleich lesen werden, sind die neuesten Informationen über die weitere Entwicklung der Staffel 42 (SCI des: SQ42).

Operateure auf der ganzen Welt haben die notwendigen Informationen gesammelt, um Ihnen diesen Fortschrittsbericht zur Verfügung zu stellen. Als Ergebnis haben wir nun Schlüsselinformationen über die Methodik hinter der Kinematik, über genehmigte einzigartige UI-Designs und darüber, wie man einen perfekten Haarkopf herstellt.

Die in dieser Mitteilung enthaltenen Informationen sind äußerst sensibel, und es ist von größter Wichtigkeit, dass sie nicht in die falschen Hände gelangen. Löschen Sie alle Aufzeichnungen nach dem Lesen.

Oberkommando der UEE-Marine

KI

Character Combat ist der Auftakt zum Februar-Bericht, der den Monat damit verbrachte, Fortschritte im Kampfverhalten zu erzielen, insbesondere durch Wiederholung der Angriffs- und Haltepositionstaktik. Sie verbesserten das Reservations-Manager-System, das normalerweise für den Einsatz von Objekten in der Welt eingesetzt wird. Dies wurde dadurch erreicht, dass die NPCs nun in der Lage sind, Raumvolumina zu reservieren, um sich korrekt zu positionieren und das Wissen darüber zu behalten, wohin die KI sie führen soll. Sie begannen damit, das KI-System so anzupassen, dass es die Vermaschung von Servern ermöglicht. Die wichtigste Voraussetzung dafür ist die Aufteilung der Verantwortung der verschiedenen Systeme nach Servern, damit das Networking-Team Probleme so schnell wie möglich korrekt testen und identifizieren kann. Außerdem passen sie das Navigationssystem an, um den Workflow für das Design der Streaming-Ebene von Objektcontainern besser zu unterstützen. Dazu gehört der Aufbau einer Pipeline, bei der Navigationsdaten in jeden Container eingebettet werden, um die Kontrolle darüber zu verbessern, welche Datenteile geladen werden. Außerdem wurde Zeit für die routinemäßige Code-Bereinigung aufgewendet, die entscheidend dafür ist, die ständig wachsende Code-Basis effizient und lesbar zu halten. Diese Bereinigung konzentrierte sich vor allem auf flugbezogene Subsumtionsaufgaben mit stark wiederholtem (oder "Boilerplate"-)Code, der weg abstrahiert werden konnte, um die Wahrscheinlichkeit von Fehlern bei der Implementierung neuer Aufgaben zu verringern.

Die Schiffs-KI schloss die erste Iteration des vollständigen 3D-Navigationssystems für NPC-Schiffe ab. Das System wird derzeit von der QA getestet, bevor es in Alpha 3.9 integriert wird. Dies ist ein wichtiger Schritt, da es neue Möglichkeiten zur Umsetzung vielfältiger Missionen bietet, die nicht auf Freifeldumgebungen beschränkt sind. Dank der dynamischen Kollisionsvermeidung konnten die derzeitigen Geschwindigkeitsbegrenzungen auf allen KI-Schiffen aufgehoben werden. Statt einer begrenzten Standardkampfmodus-Geschwindigkeit (SCM) können die NPCs nun ihre eigene Geschwindigkeit entsprechend der gewünschten relativen Zielgeschwindigkeit einstellen.

Die soziale KI hat das Verhalten der Anbieter weiter poliert und für den Einsatz in den Barbetrieben und Geschäften vorbereitet. Im letzten Monat lag der Schwerpunkt auf der Vorbereitung und Lieferung von Getränken und Cocktails - eine multidisziplinäre Anstrengung, die die Pipeline für alle zukünftigen Arbeiten im sozialen Umfeld der PU definieren wird. Nach Abschluss der Arbeit wird das Team in der Lage sein, Inhalte zu generieren und Vorlagen für verschiedene Layouts viel schneller zu erstellen. Zurzeit kann der Anbieter alles abholen und liefern, was es bereits auf der Welt gibt, z.B. eine Flasche Bier, und viele Dinge vorbereiten, die es nicht gibt, z.B. einen Cocktail. Sie arbeiten auch an anderen sozialen Verhaltensweisen, wie z.B. Fitness und Hausmeistertätigkeiten. Beide nutzen die in der Entwicklung befindliche "Pfad-Scripting"-Funktionalität. Sie dienen dazu, die Umgebung zu nutzen, um die möglichen Optionen der KI zu definieren, wie z.B. Reinigung und Patrouillenfahrten, und können dazu verwendet werden, das Skripting von Geschichtenszenen zu vereinfachen. Es funktioniert, indem es einem Designer erlaubt, Pfade in der Umgebung festzulegen, Verzweigungen für jeden Vertex zu erstellen und zu definieren, welche Subsumtionslogik ausgeführt werden kann und welche Bedingungen erfüllt sein sollten.

Kunst (Zeichen)

Der Schwerpunkt von Character lag im Februar auf Haar, Uniformen und Qualität. Sie stellten zwei neue Frisuren fertig, darunter die von Captain Noah White. Sie testeten die Maya-Werkzeuge für das Haar-Authoring ausgiebig und sind mit den Ergebnissen und der Haltbarkeit des Werkzeugs bis zur vollen Produktion äußerst zufrieden. Derzeit arbeiten sie an blondem Haar und untersuchen, wie es sich mit dem aktuellen Shader verhält; Ziel ist es, es so realistisch wie möglich zu machen. Sie haben auch weiterhin auf die Charakterköpfe verzichtet und haben mit der Arbeit an den restlichen Vorzügen der Brückenoffizier-Uniform begonnen. Als nächstes stehen die Kampfanzüge auf der Liste, deren vollständige Fertigstellung voraussichtlich zwei Monate dauern wird.

Filmkunst

"'Echtzeit, die ganze Zeit' ist nicht nur ein Mantra, das erfahrene Benutzer von Echtzeit-Engines schätzen, sondern oft auch der Grund, warum sie sich überhaupt in die Workflows und die Engine verliebt haben. Sie ermöglicht es Künstlern und Designern, schnell zu iterieren, ohne auf Offline-Bauprozesse oder Tools zurückgreifen zu müssen, die keine Echtzeitergebnisse liefern können, und macht kreative Entscheidungen sofort und ohne verzögerte Feedback-Schleifen möglich. Während der Produktion von Werkzeugen müssen wir dieses Mantra auf ein Kampfbanner schreiben und es jedes Mal schwenken, wenn neue Technik gebaut wird. In einem technologisch herausfordernden und über die Grenzen des modernen Spieluniversums hinausgehenden Universums kann der Druck, die Dinge in Echtzeit zu halten, komplex werden. In der Filmkunst ist es beispielsweise einfacher, auf einen traditionellen Offline-Rendering-Workflow zurückzugreifen. Offline können Sie die Details, Beleuchtung, Schatten, Bewegungsunschärfe, LODs und Tiefenschärfe bis zum Maximum steigern, bevor Sie eine Bildsequenz rendern und die endgültige Sequenz in einer Videobearbeitungssoftware zusammenschneiden. Das Endergebnis ist jedoch ein Video mit fester Auflösung und Bitrate, das dann mit Hilfe eines Videocodecs, der hervorheben kann, dass Elemente oder vollständige Sequenzen nicht in Echtzeit vorliegen, in das Build eingefügt werden muss. Um die Authentizität und das Eintauchen in SQ42 zu gewährleisten, war es schon immer das Ziel, selbst bei den größten Sequenzen des Filmsatzes auf Echtzeit-Kinofilme zu drängen.

- Das Filmteam

Im Februar hat Cinematics eine der anspruchsvollsten Sequenzen durch den zweiten Durchgang geschoben und das Timing vor dem Start der VFX- und Zerstörungssimulation festgelegt. Das aktualisierte TrackView-Sequenzer-Tool wurde fertiggestellt, so dass das Team diese langen, epischen Sequenzen nun endlich in Echtzeit bearbeiten kann. Es fügte mehrere Untersequenz-Fähigkeiten und eine auf der Sequenz basierende Kameraprioritätslogik hinzu. Diese Sequenzen verhalten sich wie Videoclips, so dass es möglich ist, komplexe Setups in Echtzeit zu bearbeiten, wobei jede Teilsequenz auf der Master-Zeitachse verschoben wird. So kann das Team beispielsweise einzelne Großkampfschiffe und Außenflotten auf separaten Sequenzen haben und sie alle in einem Master kombinieren, mit der Fähigkeit, schnell zu behaupten, wo die Kameraschnitte stattfinden sollen. Eine weitere Herausforderung besteht darin, das Streaming-System zum Einsatz zu bringen, wenn zwischen mehreren entfernten Orten hin- und hergeschnitten wird. Bei den meisten Streaming-Technologien wird davon ausgegangen, dass die Aufnahmen nicht ständig zwischen verschiedenen Orten hin- und hergeschnitten werden. Daher wird der Schwerpunkt des Arbeitsablaufs des Teams in Zukunft darauf liegen, dies aufzupolieren.

Technik

In Frankfurt arbeitete die Technik an Physics Threading und Performance, einschließlich der Untersuchung der vollständigen Parallelisierung von Integrationsteilen im Physics Time Step Code, Multithreading der Polygonize-Funktion für Innenvolumen, Fortsetzung des Concurrent/Intermediate Queuing für die Physik, Implementierung lokaler Befehlswarteschlangen und Hinzufügen einer Option zur Erstellung von Warteschlangen bei Bedarf. Sie begannen mit der Fertigstellung und Integration des neuen SDF-Systems (Signed Distance Field), um die Kollisionsprüfung komplexer Geometrien zu beschleunigen und die Präzision der Ergebnisse zu erhöhen. Vereinheitlichte Felder können nun wie jeder andere Teil animiert werden (sie sind in mancher Hinsicht immer noch speziell, können aber von außen als regulärer Teil betrachtet werden) und Abstandsfelder auf Objekten können bei der Abtastung von Abständen berücksichtigt werden.

In Bezug auf die Optimierung haben sie die Physik auf Hautanhängen deaktiviert und Verbesserungen der OC- und SDF-Größe sowie Zuordnungsoptimierungen für Innenvolumen vorgenommen. Sie ermöglichten die Unterstützung von Statusaktualisierungen und Zonen mit 64-Bit-Präzision im Blattwerk, ließen Proxy-Rendering für Seile mit dem Zonensystem arbeiten, setzten die Arbeit an Animationen der Todesreaktion fort und unterstützten das Ziehen von Schauspielern/Ragdoll-Körpern.

Es wurde an dem Zonensystem gearbeitet, während ein Aktualisierungs-Thread für die Keulung eingeführt wurde, um Aktualisierungen der räumlichen Keulungsstrukturen zu parallelisieren. Das Team optimierte das Streaming, indem es viele unnötige atomare Operationen auf Smart-Pointer-Kopien übersprang und die Parallelisierung des Occlusion Culling reduzierte. Sie nahmen auch Verbesserungen bei der Prüfung des gleichzeitigen Zugriffs (Unterstützung der Prüfung der RW-Lock-Semantik) und Verbesserungen der WAF vor.

Zur Unterstützung des Gen12-Renderers und von Vulkan wurden Texturansichten verallgemeinert, der Texturerzeugungsprozess und der verbleibende D3D-Texturansichtscode überarbeitet, MSAA-Unterstützung hinzugefügt, der alte direkte VB/IB-Speicherzugriffscode entfernt, ViewInfo für den Zugriff auf gängige ansichts- und kamerabezogene Parameter hinzugefügt und das Verschieben des Shader-Parsing in den Ressourcencontainer untersucht. Der erste Verbesserungsdurchgang für Haar-AO wurde durchgeführt, der nun mit Farbe gekoppelt ist, und es wurde eine Weichheit der Farbstoffverschiebung eingeführt. Verbesserungen bei den Ozean-Shadern wurden ebenfalls vorgenommen, indem das Ozean-Rendering auf verzögerte und weitere Arbeiten an Würfelkartenreflexionen übertragen wurden.

Der Raymarcher wurde vereinfacht, indem die expliziten Auswertungen von Segmenten entfernt wurden, um den generierten Code deutlich zu verdichten und die Verwendung von Registern zu reduzieren. Außerdem wurde ein nichtlinearer Schritt für das Raymarchen implementiert, um die Qualität bei einer reduzierten Anzahl von Proben zu verbessern. Das Planetengelände wurde iterativ bearbeitet, um die Darstellung großer bodengebundener Objekte auf den Höhen- und Schattenkarten zu unterstützen. Es wurde auch ein Live-Mo-Cap-Plugin für den Editor erstellt. Schließlich wurde der Animationscode geändert, um sicherzustellen, dass die Ragdolls mit der Bodenausrichtung arbeiten, und der CHR-Chunk-Lader wurde vereinfacht, um die Physik zu initialisieren (was noch nicht abgeschlossen ist).

Speziell für SQ42 schloss das Team seine Arbeit an der Unterbrechung, dem Wiedereintritt und dem Verzicht auf die Funktionalität für Story-Szenen ab. Sie beheben derzeit verschiedene Randfälle und visuelle Probleme, wie z.B. Animationsstörungen, und fügen ein neues System hinzu, um den Designern eine bessere Kontrolle darüber zu geben, wann und wie Ereignisse ausgelöst werden. Die Technik unterstützte die Filmdesigner auch bei den erforderlichen TrackView-Anforderungen, um sicherzustellen, dass alles in der vorgesehenen Weise funktioniert.

Spielgeschichte

Der Februar war ein arbeitsreicher, aber produktiver Monat für Gameplay Story, der an einer Vielzahl von Szenen arbeitete, darunter auch die Unterstützung des Designs mit Animationen für den Abandon-Mechaniker. Sie überprüften auch die Gespräche der NPCs mit Design und Narrative und fügten zusätzliche Dialoge hinzu, um sie natürlicher zu gestalten. Alle Med-Bay-Szenen in Kapitel sechs wurden aktualisiert, um, wo immer möglich, korrekte Start- und End-Idle-Szenen hinzuzufügen. Dies war eine umfassende Überarbeitung, die zu Gesprächen führte, die mit viel mehr Kontrolle ausgelöst werden können. Dadurch wird sichergestellt, dass die Szenen gut aussehen und mit dem gewünschten Tempo ablaufen. Eine Szene mit zwei Figuren, die eine große Kiste eine Rampe hinauftragen, wurde nach einer beträchtlichen Mo-Cap-Naht fertiggestellt und sieht derzeit großartig aus. Schließlich wurden für die Gameplay-Story neue Schauspieleraufnahmen und Ladevorgänge erstellt, so dass mehrere Szenen-Setups fertig gestellt werden können.

Grafiken

Das Grafikteam setzte die entscheidende Arbeit am Gen12/Vulkan-Renderer fort und konvertierte die Systeme für Kachellicht und dynamische Geometrie in das neue Rendering-Paradigma. Sie machten auch verschiedene Verbesserungen am automatisierten Testsystem notwendig, um die Stabilität für die Designer und Künstler zu gewährleisten.

Level-Design

Das Sozialteam setzte in Zusammenarbeit mit Animation und Technik die Arbeit an den Erzählsequenzen und dem Verzicht auf die Funktion fort. Derzeit konzentrieren sie sich auf frühe, kapitelweise Durchspiele, die die Spieler in das Leben eines UEEN-Piloten einführen. Sie arbeiten weiterhin eng mit dem FPS AI Feature Team zusammen, um das Verhalten der KI zu platzieren und zu verfeinern. Eines der Hauptziele ist es, dass sich die NPCs realistisch verhalten, unabhängig von der Umgebung, in der sie sich befinden. Die Ebenen des Spiels sind so gestaltet, dass sie architektonisch glaubwürdige Räume sind, daher muss sich die KI auf glaubwürdige Weise an sie anpassen. Das Dogfighting-Team arbeitet mit der Flug-KI zusammen, um Szenarien zu verfeinern, die eine individuelle technische Unterstützung erfordern. Sie unterstützen auch die laufenden Arbeiten an der Umgebung und die Aktualisierungen der Schiffslebensdauer und der Start-/Landung.

Erzählung

Einige Mitglieder des in den USA ansässigen Erzählteams besuchten die britischen Studios, um die neuesten Fortschritte zu überprüfen und eine Sitzung mit Frauenfiguren zu beaufsichtigen. Sie überprüften auch die kleineren NPC-Gespräche mit dem Gameplay Story Team, um sicherzustellen, dass sie so glaubwürdig wie möglich sind.

QA

Es wurden Kampf- und Schiffs-KI-Testfälle implementiert, die das Team nun regelmäßig testen wird. Sie sind immer noch mit der Erstellung von aufgezeichneten Kundenszenenaufnahmen einzelner Kapitel beauftragt und untersuchen derzeit Probleme, die den filmischen Workflow behindern.

Technische Animation

Die Tech-Animation verbesserte das visuelle Erscheinungsbild für das Laden von Charakteren neben Character Art und Cinematic Design. Sie fügten den Maya-Engine-Auslastungen hinzu, damit die Animatoren ihren letzten Schliff mit derselben Auslastung erhalten, die die Charaktere im Spiel tragen werden. Der Animations-Workflow wurde durch die Behebung verschiedener Fehler und das Hinzufügen von Werkzeugen zur Pipeline verbessert, um den Backprozess für größere Szenen zu beschleunigen.

Mehrere neue Waffen erreichten die Tech Animation, während das soziale KI-Team mit neuen Gebrauchsgegenständen für das Sitzen, Stehen, Übungsplätze und den Barkeeper unterstützt wurde. Sie arbeiteten auch mit Props zusammen, um Probleme mit ihrem Rigger-Tool zu lösen und Fehler für Design, Animation und Kunst zu beheben.

Technische Kunst

Letzten Monat implementierte Tech Animation einen neuen Rig-Logic-Editing-Plugin-Befehl für Maya. Aus Gründen der Leistung und Effizienz wurde das Backend in C++ implementiert. Die Qt-basierte Frontend/UI-Schicht wird derzeit mit Python implementiert. Während die Vanduul-Face-Rigs bereits diese neue Runtime-Rig-Logik verwenden, werden bald alle über 120 Human Face-Rigs auf das neue System portiert werden.

Benutzerschnittstelle (UI)

Im Februar half die Benutzeroberfläche dem Schauspieler-Team bei der Fertigstellung der Visuals für das Radialmenü "Inner Thought". Nach einer Menge an Konzepten und UI-Design wurden das neue SQ42-spezifische Visier und das visuelle Ziel genehmigt. Die Prototypentwicklung ist im Gange, bevor im nächsten Monat die Code-Arbeiten beginnen.

VFX

Das britische VFX-Team schloss den Monat ab, indem es mehrere bestehende Hintergrundeffekte korrigierte und die jüngsten Verbesserungen der Eltern-Kind-Hierarchie des Partikelsystems nutzte. Die Untersuchung weiterer Methoden zur Auslösung von Partikeleffekten durch Gastechnik wurde ebenfalls begonnen.

In Frankfurt arbeitete das Team zusammen mit den Programmierern an der endgültigen Liste der für SQ42 erforderlichen Funktionen. Dazu gehörte die Behebung langjähriger Fehler auf dem GPU-System, einschließlich Inkonsistenzen mit der Eltern/Kind-Laichfähigkeit, um eine viel tiefere Hierarchie und komplexere Effekte zu erreichen. Dies wurde mit dem Feuerwerk VFX getestet, das das System an seine Grenzen brachte und half, bisher unbekannte Fehler aufzudecken.

WIR SEHEN UNS NÄCHSTEN MONAT...

This is a cross-post of the report that was recently sent out via the monthly Squadron 42 newsletter. We’re publishing this a second time as a Comm-Link to make it easier for the community to reference back to. Attention Recruits,

What you are about to read is the latest information on the continuing development of Squadron 42 (SCI des: SQ42).

Operatives around the world collected the intel needed to provide you with this progress report. As a result, we now have key information on the methodology behind cinematics, approved unique UI designs, and how to make a perfect head of hair.

The information contained in this communication is extremely sensitive and it is of paramount importance that it does not fall into the wrong hands. Purge all records after reading.

UEE Naval High Command

AI

Character Combat kick off February’s report, who spent the month making progress on combat behaviors, specifically iterating on the assault and hold position tactics. They improved the Reservation Manager System usually employed to reserve object use in the world. This was achieved by adding the ability for NPCs to reserve volumes of space to correctly position themselves and retain the knowledge of where the AI wants them to go. They began adjusting the AI system to accommodate server meshing. The main requirement for this is to split the responsibility of the different systems by server so that the Networking Team can correctly test and identify problems as soon as possible. They’re also tweaking the navigation system to better support the object container streaming level design workflow. This involves constructing a pipeline where navigation data is embedded in each container to improve control over which portions of data are loaded. Also, time was dedicated to the routine code clean-up that’s crucial to keeping the ever-growing code base efficient and readable. This clean-up focused mostly on flight-related Subsumption tasks with heavily repeated (or ‘boilerplate’) code that could be abstracted away to reduce the likelihood of errors when implementing new tasks.

Ship AI completed the first iteration of the full 3D navigation system for NPC ships. The system is currently with QA for testing before it’s integrated into Alpha 3.9. This is an important step as it offers new opportunities to implement more diverse missions not limited to open-space environments. Thanks to dynamic collision avoidance, they were able to remove the current speed limits on all AI ships. Instead of a capped standard combat mode (SCM) speed, NPCs can now set their own according to the desired relative goal velocity.

Social AI continued polishing vendor behavior, readying it for use in the bar setups and shops. Last month’s focus was preparing and delivering drinks and cocktails – a multi-disciplinary effort that will define the pipeline for all future social environments work in the PU. When finished, the team will be able to generate content and create templates for multiple layouts much quicker. Currently, the vendor can pick up and deliver anything that already exists in the world, such as a bottle of beer, and prepare many things that don’t, such as a cocktail. They’re also working on other social behaviors, such as fitness and janitor activities. Both leverage the in-development ‘path scripting’ functionality. The purpose of this is to use the environment to define the AI’s possible options, such as cleaning and patrolling, and can be used to simplify the scripting of story scenes. It works by allowing a designer to lay down paths in the environment, create branches for each vertex, and define which subsumption logic can be executed and which conditions should be met.

Art (Characters)

Character’s February focus was on hair, uniforms, and quality. They completed two new hairstyles, including that of Captain Noah White. They thoroughly tested the Maya tools for hair authoring and are extremely pleased with the results and how the tool’s holding up to full production. They currently working on blonde hair, investigating how it behaves with the current shader; the aim is to make it as realistic a shade as possible. They also continued making passes on character heads and have started work on the rest of the Bridge Officer Uniform assets. Next on the list are battledress uniforms, which are expected to take two months to complete in their entirety.

Cinematics

“‘Real-time, all the time’ isn’t just a mantra that veteran real-time engine users appreciate, it’s often the reason they fell in love with the workflows and engine in the first place. It enables artists and designers to quickly iterate without having to resort to offline build processes or tools not capable of giving real-time results, making creative decision-making instant and not reliant on delayed feedback loops. During tools production, we have to write this mantra on a battle banner and wave it every time new tech is built. With a technologically challenging and beyond cutting-edge game universe, the push to keep things in real-time can become complex. For example, in cinematics, it’s magnitudes easier to resort to a traditional offline rendering workflow. Offline, you can crank up the detail, lighting, shadows, motion blur, LODs, and depth of field to the max before rendering out an image sequence and cutting the final sequence together in video-editing software. However, the end-result is a video with fixed resolution and bitrate that then has to be added to the build using a video codec that can highlight that elements or full sequences aren’t real-time. To maintain authenticity and immersion in SQ42, the goal has always been to push for real-time cinematics during even the biggest set-piece sequences.”

- The Cinematics Team

February saw Cinematics push one of the most challenging sequences through its second pass, locking down the timing before starting VFX and destruction simulation. The upgraded TrackView sequencer tool was completed, finally enabling the team to edit these long, epic sequences in real-time. They added several sub-sequence abilities and a camera priority logic based on the sequence sitting on top. These sequences behave like video clips, making it possible to edit complex setups in real-time, shifting each sub-sequence around on the master timeline. For example, the team can have individual capital ships and exterior fleets on separate sequences and combine them all in a master, with the ability to quickly assert where they want the camera cuts to happen. Another challenge is to get the streaming system working when cutting back and forth between several distant locations. Most game-streaming tech is built with the assumption shots aren’t constantly cutting back and forth between different locales, so getting this polished is the upcoming focus for the team’s workflow.

Engineering

In Frankfurt, Engineering worked on physics threading and performance, including investigating the full parallelization of integration parts in physics time step-code, multithreading the polygonize function for interior volumes, continuing concurrent/immediate queuing for physics, implementing local command queues, and adding an option to create queues on demand. They began finalizing and integrating the new signed distance field (SDF) system to accelerate collision checks on complex geometry and increase the precision of results. Unified fields can now be animated as any other part (they’re still special in some regards, but can be seen as a regular part from the outside) and distance fields on objects can be taken into account when sampling distances.

Optimization-wise, they disabled physics on skin attachments and made OC and SDF-size improvements and allocation optimizations for interior volumes. They enabled foliage to support 64-bit precision status updates and zones, made render proxy for ropes work with the zone system, continued work on death reaction animations, and provided support for actor/ragdoll body dragging.

Work was done to the zone system, while a culling update thread to parallelize updates of spatial culling structures was introduced. The team optimized streaming by skipping many unnecessary atomic operations on smart pointer copies and reduced the parallelization of occlusion culling. They also made improvements to the concurrent access check (support checking RW-lock semantics) and WAF improvements.

In support of the Gen12 renderer and Vulkan, they generalized texture views, refactored the texture creation process and remaining D3D texture view code, added MSAA support, removed old direct VB/IB memory access code, added ViewInfo for access to common view/camera related parameters, and looked into moving shader parsing into the resource container. The first improvement pass for hair AO was made, which is now coupled with color, and dye shift softness was introduced. Ocean shader improvements were made too by porting ocean rendering to deferred and further working on cube map reflections.

The raymarcher was simplified by removing the explicit evaluations of segments to significantly compact generated code and reduce register usage. Non-linear stepping for raymarching was also implemented to improve quality at a reduced number of samples. Planet terrain was iterated on to support the rendering of large ground-based objects on the height and shadow maps. A persona live mo-cap plugin for the editor was created too. Finally, animation code was amended to ensure ragdolls work with ground alignment and the CHR chunk loader was simplified to initialize physics (which is still ongoing).

Specifically for SQ42, the team completed their work on the interrupt, rejoin, and abandon functionality for story scenes. They’re currently fixing various edge cases and visual problems, such as animation glitches, and adding a new system to give the designers better control over when and how events are triggered. Engineering also supported the cinematic designers with their required TrackView requirements, making sure everything works in the intended manner.

Gameplay Story

February was a busy but productive month for Gameplay Story, who worked on a wide variety of scenes, including supporting Design with animations for the abandon mechanic. They also reviewed NPC conversations with Design and Narrative, adding extra dialogue to make them more natural. All med-bay scenes in chapter six were updated to add proper start and end idles wherever possible. This was an extensive overhaul, resulting in conversations that can be triggered with much greater control. This will ensure the scenes look good and play out with the desired pacing. A scene with two characters carrying a large box up a ramp was completed after considerable mo-cap stitching and is currently looking great. Finally for Gameplay Story, new actor records and loadouts were created so several scene setups can be finalized.

Graphics

The Graphics Team continued crucial work on the Gen12/Vulkan renderer, converting the tiled-lighting and dynamic geometry systems to the new rendering paradigm. They also made various improvements to the automated testing system necessary to ensuring stability for the designers and artists.

Level Design

The Social Team, in collaboration with Animation and Engineering, continued work on narrative sequences and the abandon functionally. They’re currently focusing on early full-chapter playthroughs that introduce players to the life of a UEEN pilot. They continue to work closely with the FPS AI Feature Team to place and refine AI behaviors. One of the main aims is to have NPCs behave realistically, regardless of the environment they’re placed in. The game’s levels are designed to be architecturally believable spaces, so the AI needs to adapt to them in believable ways. The Dogfighting Team are working with Flight AI to refine scenarios that require custom engineering support. They’re also supporting the ongoing ambient ship-life work and take-off/landing updates.

Narrative

Some of the US-based Narrative Team visited the UK studios to review the latest level progress and oversee a female-character mo-cap session. They also reviewed the smaller NPC conversations with the Gameplay Story Team to ensure they’re as believable as possible.

QA

Combat and Ship AI test cases were implemented, which the team will start testing regularly. They’re still tasked with creating recorded client scene captures of individual chapters and are currently investigating issues hindering the cinematics workflow.

Tech Animation

Tech Animation improved visuals for character loadouts alongside Character Art and Cinematic Design. They added engine loadouts to Maya to enable the animators to complete their polish pass on the same loadout the characters will wear in-game. The animation workflow was improved by fixing several bugs and adding tools to the pipeline to speed up the bake process for bigger scenes.

Several new weapons reached Tech Animation, while the Social AI Team was supported with new usables for sitting, standing, exercise spots, and the bartender. They also worked with Props to solve problems with their rigger tool and fixed bugs for Design, Animation, and Art.

Tech Art

Last month, Tech Animation implemented a new rig-logic editing plugin command for Maya. For performance and efficiency, the backend was implemented in C++. The Qt-based frontend/UI layer is currently implemented using python. While the Vanduul face rigs already use this new runtime rig logic, all 120+ human face-rigs will soon be ported over to the new system.

User Interface (UI)

February saw UI helping the Actor Team finalize visuals for the Inner Thought radial menu. After a lot of concepting and UI design, the new SQ42-specific visor and visual target were approved. Prototyping is ongoing before code work begins next month.

VFX

The UK’s VFX Team closed out the month tweaking several existing background effects and taking advantage of recent improvements to the particle system’s parent/child hierarchy. Investigation into further methods of triggering particle effects through gas tech was started too.

In Frankfurt, the team worked with the programmers to lockdown the final list of features required for SQ42. This included fixing long-standing bugs on the GPU system, including inconsistencies with parent/child spawning, to give a much deeper hierarchy and more complex effects. This was tested with firework VFX that pushed the system to its limits and helped uncover previously unknown bugs.

WE’LL SEE YOU NEXT MONTH…

What you are about to read is the latest information on the continuing development of Squadron 42 (SCI des: SQ42).

Operatives around the world collected the intel needed to provide you with this progress report. As a result, we now have key information on the methodology behind cinematics, approved unique UI designs, and how to make a perfect head of hair.